Cần thận trọng khi chia sẻ thông tin cá nhân với chatbot AI

(SHTT) - Chatbot AI giả lập cuộc trò chuyện với người dùng thông qua thuật toán học máy và xử lý ngôn ngữ tự nhiên. Tuy tiện lợi nhưng các chuyên gia khuyến cáo người dùng không nên chia sẻ quá nhiều thông tin, đặc biệt là dữ liệu nhạy cảm và các nguy cơ tiềm ẩn từ việc lạm dụng thông tin cá nhân.

Chatbot AI tuy tiện lợi nhưng đằng sau vẫn luôn ngầm chứa những sự nguy hại mà con người chưa lường trước được bởi lẽ những chatbot như ChatGPT không nằm trong nhóm phải tuân thủ Đạo luật về trách nhiệm giải trình và cung cấp thông tin bảo hiểm y tế (HIPAA), do đó, người dùng không nên sử dụng những chatbot này để tóm tắt bệnh án, xin tư vấn sức khỏe hay cấp quyền truy cập vào các dữ liệu riêng tư.

Theo các chuyên gia, việc chia sẻ quá nhiều thông tin sẽ dẫn tới những việc nguy hại khó lường trước được như sau:

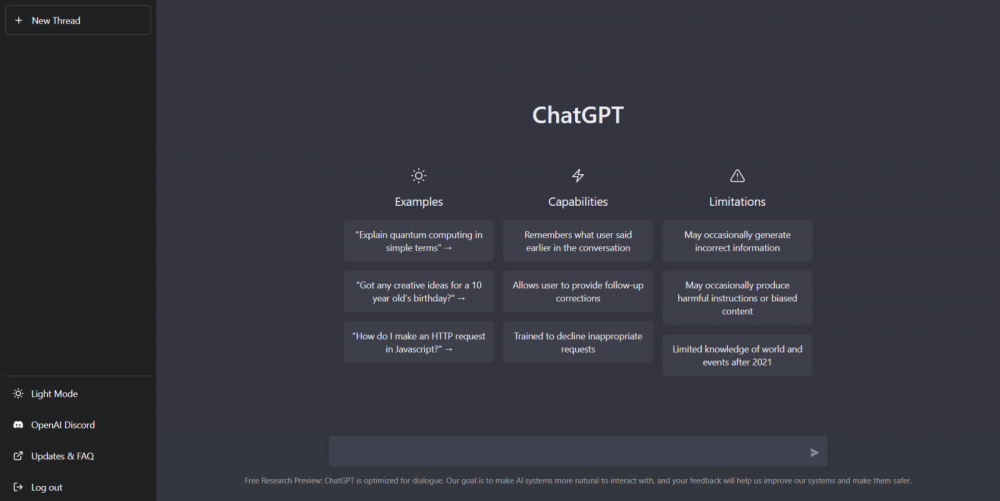

Thứ nhất, làm lộ thông tin cá nhân Mặc dù "ChatGPT" không lưu trữ dữ liệu người dùng lâu dài, việc chia sẻ thông tin nhạy cảm như địa chỉ, số điện thoại, hoặc chi tiết tài khoản có thể dẫn đến nguy cơ lộ lọt thông tin nếu có sự cố bảo mật. Những dữ liệu này có thể bị xâm nhập và lạm dụng.

Thứ hai, sử dụng sai mục đích khi các chatbot AI có thể lưu trữ và sử dụng thông tin bạn cung cấp để cải thiện hệ thống. Tuy nhiên, không có sự kiểm soát chặt chẽ về cách thức và mục đích sử dụng dữ liệu này, khiến chúng có thể bị lạm dụng cho những mục đích không rõ ràng hoặc ngoài ý định ban đầu của bạn.

Thứ ba, Chatbot AI có thể đưa ra các thông tin hoặc lời khuyên không chính xác hoặc không phù hợp, đặc biệt trong các tình huống cần độ chính xác cao như tư vấn sức khỏe hoặc tài chính. Điều này có thể dẫn đến quyết định sai lầm với hậu quả nghiêm trọng.

Thứ tư, nguy cơ bị lợi dụng trong các cuộc tấn công mạng. Dữ liệu cá nhân chia sẻ trong cuộc trò chuyện có thể là mục tiêu của các cuộc tấn công mạng. Nếu thông tin này bị hacker xâm nhập, nó có thể được sử dụng để thực hiện các hành vi gian lận, đánh cắp danh tính hoặc lừa đảo.

Thứ 5, khó kiểm soát thông tin, một khi bạn chia sẻ thông tin với chatbot, việc kiểm soát và theo dõi cách thức sử dụng và lưu trữ thông tin đó là rất khó khăn. Điều này có thể tạo ra sự thiếu minh bạch và các vấn đề về quyền riêng tư.

Việc chia sẻ quá nhiều thông tin với "Chatbot AI" cũng có thể làm giảm độ chính xác của các phản hồi. Vì chatbot hoạt động dựa trên dữ liệu được huấn luyện từ một lượng lớn thông tin, nhưng không thể hiểu rõ ngữ cảnh cá nhân của bạn như một con người thực sự. Do đó, nếu chia sẻ quá nhiều, bạn có thể nhận được những lời khuyên không phù hợp hoặc không hoàn toàn chính xác, gây hiểu lầm hoặc quyết định sai lầm trong những tình huống quan trọng.

Bên cạnh đó, các chuyên gia cũng khuyến cáo về những nội dung khác cũng cần tránh chia sẻ với AI, bao gồm: thông tin đăng nhập, dữ liệu tài chính, câu trả lời cho câu hỏi bảo mật, tên, số điện thoại, địa chỉ cá nhân... Những nội dung nhạy cảm, lời khuyên bất hợp pháp hay thông tin cá nhân của người khác cũng được khuyến cáo không chia sẻ với chatbot bởi những dữ liệu này có thể bị lợi dụng, khai thác cho mục đích xấu.

Duy Anh

Link nội dung: https://itoday.vn/can-than-trong-khi-chia-se-thong-tin-ca-nhan-voi-chatbot-ai-a459890.html